Il musicista elettronico

Fare musica con il computer

Dalla dimensione acustica a quella digitale

Video tutorial per l’uso di software musicali

7 progetti ispirati a situazioni reali

Dalla dimensione acustica a quella digitale

Video tutorial per l’uso di software musicali

7 progetti ispirati a situazioni reali

L’obiettivo di questo fascicolo è insegnare a fare suoni e musica utilizzando il computer. Utilizzando il computer, saremo in grado di operare sul suono ed ottenere esiti sorprendenti: ad esempio, potremo creare suoni “inauditi”, impossibili da produrre con gli strumenti tradizionali, oppure potremo inventare brani musicali aggregando materiali sonori non convenzionali come, ad esempio i suoni ambientali, oppure ancora potremo ricostruire le partiture dei maestri del passato per poi trasformarle completamente.

Per cogliere al meglio tali opportunità, dobbiamo fare un passo indietro e chiederci qual è la differenza tra fare musica con gli strumenti tradizionali e fare musica con il computer.

Per comprendere questa differenza, facciamo un esempio.

Il 1º luglio 2017 la famosa rock star italiana Vasco Rossi si esibisce nel “Modena Park 2017”, un evento musicale senza precedenti, che batte il primato mondiale del concerto con il più alto numero di spettatori paganti. Il numero di partecipanti, infatti, è altissimo: 220 mila, tanti quanto gli abitanti della città di Padova, distribuiti su una superficie di 400 mila metri quadri, pari a circa 40 campi da calcio. L’evento viene seguito a distanza via radio, televisione e internet da 5 milioni e mezzo di fan. Il consumo di energia elettrica per 4 ore di concerto è pari a 1 Megawatt. Ancora oggi possiamo reperire il documento audiovisivo della serata, guardarlo e vivere di nuovo quella serata memorabile.

Ma cosa sarebbe accaduto se, per un imprevisto, fosse venuta meno l’energia elettrica? Probabilmente Vasco Rossi e la sua band si sarebbero esibiti comunque, utilizzando voci, chitarre acustiche, trombe e batteria, ma rinunciando a tutti quegli strumenti che producono suono soltanto se alimentati da energia elettrica, quali, ad esempio, le chitarre elettriche, il basso elettrico, le tastiere elettroniche. Il concerto si sarebbe comunque tenuto ma sarebbe stato seguito solamente dal piccolo gruppo di persone vicine al palco e nessuno dei partecipanti distanti lo avrebbe ascoltato, né il pubblico pagante posto sulle file più lontane, né i fan rimasti a casa davanti alla televisione. Infine, nessuno di noi avrebbe oggi la possibilità di vivere di nuovo quell’esperienza, poiché non ci sarebbe alcuna documentazione audiovisiva. Privata della connessione all’energia elettrica, la performance di Vasco Rossi sarebbe stata di tipo acustico: in altre parole, suoni, voci e musica prodotti dai musicisti avrebbero raggiunto direttamente le orecchie dell’ascoltatore attraverso l’aria, senza passare attraverso un sistema di circuiti elettrici.

Dunque, il grande evento che ha polverizzato ogni record europeo è stato possibile grazie ad una risorsa, l’energia elettrica, e grazie ad un’operazione sul suono: l’elettrificazione, vale a dire il passaggio dalla dimensione acustica a quella elettronica.

Cercheremo ora di comprendere con maggiore precisione in che cosa consiste l’elettrificazione del suono, vale a dire il suo passaggio dalla dimensione acustica a quella elettronica, poiché è in quest’ultima che il computer, detto anche “calcolatore elettronico”, offre straordinarie possibilità.

Come si produce un suono, il fruscio del vento o lo sfrecciare di un treno? Come arriva alle nostre orecchie, a partire dalla sua sorgente sonora? Ce lo dimostra un semplice esperimento.

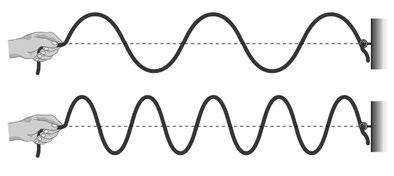

Prendiamo un elastico e tendiamolo sopra una scatola: se la pizzichiamo, comincia a vibrare e ad emettere un suono che svanisce appena l’elastico cessa di vibrare e torna alla posizione iniziale. (Fig. 1)

Ripetiamo l’esperimento con un’asta metallica non rigida, per esempio un righello, tenuta ferma a un’estremità: il suono svanisce quando blocchi l’asta. (Fig. 2)

Un suono dipende dunque dalle vibrazioni di un corpo, la sorgente sonora. La proprietà di produrre vibrazioni è una caratteristica dei corpi elastici, cioè dei corpi che possono subire una deformazione e ritornare poi alla loro condizione iniziale.

Negli strumenti musicali il suono può essere generato dalle vibrazioni di corde (pianoforte, violino, chitarra ecc.), di colonne d’aria (clarinetto, tromba ecc.), di membrane (tamburo), di legni o metalli percossi (triangolo, sonagli).

Per essere percepite come suono, le vibrazioni delle sorgenti sonore devono arrivare sino al nostro orecchio, perciò è necessario un mezzo che le trasporti: nella maggioranza dei casi tale mezzo è l’aria, ma può anche essere l’acqua o un corpo solido, come il legno o il ferro.

Fissiamo una lamina metallica al bordo di un tavolo e facciamola vibrare. Quando la lamina si solleva, le molecole d’aria con cui è a contatto sono spinte verso l’alto e si avvicinano; quando la lamina si abbassa le molecole si allontanano; questi movimenti delle molecole si trasmettono nell’aria fino ad arrivare al timpano del nostro orecchio, e vengono percepiti come suoni. (Fig. 3)

La vibrazione genera una successione di compressioni e di espansioni delle molecole che circondano la sorgente. Questo fenomeno è detto onda sonora . Per meglio comprenderlo, pensa a che cosa succede quando lanciamo un sassolino sulla superficie piatta di uno stagno: sull’acqua si forma un’increspatura, un’onda, che si allarga progressivamente sino a giungere ai bordi dello stagno. L’onda sonora è qualcosa di simile: la perturbazione prodotta dal sasso che cade nell’acqua si trasmette nell’aria fino a raggiungere l’orecchio.

Nel vuoto le vibrazioni della sorgente sonora non possono propagarsi e quindi il suono non si trasmette. Lo si verifica nel laboratorio di fisica: se si mette una suoneria sotto una campana di vetro e si crea il vuoto al suo interno, il suono non si sente più.

La forma di un’onda

Per rappresentare graficamente un’onda si usa una particolare curva, in cui le parti più alte sono dette creste e le parti più basse ventri. L’oscillazione completa di un corpo che vibra è il movimento completo, da cresta a cresta, o da ventre a ventre. La distanza si chiama lunghezza d’onda , mentre la metà della distanza verticale tra due creste o due ventri è detta ampiezza dell’onda. (Fig. 4)

Il numero di oscillazioni compiute in un secondo è detto frequenza , e si misura in hertz (Hz) dal nome del fisico tedesco dell’Ottocento Heinrich Hertz. Una frequenza di 1 Hz corrisponde a un’oscillazione completa in un secondo. (Fig. 5)

I suoni si distinguono uno dall’altro in base a tre criteri. Ognuno corrisponde a particolari proprietà delle onde sonore.

L’altezza

L’altezza è il carattere del suono che distingue i suoni gravi (o bassi) da quelli acuti (o alti). Acuto possiamo considerare per esempio il fischio di un merlo; grave il muggito di un bue. Un bicchiere vuoto percosso con un oggetto metallico emette un suono più acuto di un bicchiere pieno.

L’altezza dipende dalla frequenza delle oscillazioni. Più alto è il numero di oscillazioni, più acuto è il suono.

L’orecchio umano percepisce suoni con frequenze comprese tra 16 e 20000 Hz. Le frequenze percepite meglio sono quelle corrispondenti alla voce umana, comprese tra 2000 e 5000 Hz. (Fig. 6)

La figura 11 riassume in sintesi quanto esposto nel precedente paragrafo, ovverosia le fasi in cui si articola il fenomeno sonoro nella sua dimensione acustica, in assenza di energia elettrica: la produzione sonora (p), la trasmissione del segnale acustico (s.a.) e la sua ricezione (r).

In questo modo si propaga il suono della voce di un cantante quando si esibisce unplugged, cioè “scollegato”, vale a dire senza alcuna connessione con i dispositivi elettrici per l’amplificazione del suono. Come fare per avvalersi delle possibilità offerte dall’energia elettrica, che Vasco Rossi ha saputo sfruttare abilmente nel corso del suo concerto a Modena?

Proviamo ad osservare insieme quali sono passi da compiere per portare il suono dalla dimensione acustica alla dimensione elettronica, o, in altre parole, per trasformare il segnale acustico in segnale elettrico, e quali sono i dispositivi che consentono di farlo. Con l’aiuto della figura 12, esploriamo dunque quella che i tecnici chiamano “la catena elettroacustica”.

Per aiutarci nella comprensione, immaginiamo di trovarci in un mondo fantastico, nel quale una cittadella fortificata, difesa da mura possenti, è il dominio elettronico, mentre il territorio circostante rappresenta il dominio acustico. Il visitatore proveniente dalla campagna (l’elemento sonoro) potrà accedere alla cittadella fortificata, e godere dei vantaggi che essa offre, soltanto passando attraverso la porta di città: il varco è sorvegliato giorno e notte da una guardia (il microfono), impegnata a “vestire adeguatamente” il visitatore, per renderlo idoneo alle regole della città. Dalla parte opposta del recinto murario, a presidio della porta di uscita, una seconda guardia (cassa acustica) accoglierà il visitatore che avrà terminato l’esperienza in città, gli restituirà i suoi panni e gli consentirà di riprendere il cammino verso al campagna.

funzionare un motore; ad esempio, sono elettrici tutti gli elettrodomestici quali il frigorifero, l’aspirapolvere, il frullatore. Il dispositivo è elettronico se è dotato di un circuito sul quale viaggia l’energia elettrica a basso voltaggio (toccando il quale non si prenderebbe la scossa) allo scopo di veicolare informazioni.

Per descrivere le attività sul suono nella dimensione elettronica utilizzeremo entrambi gli aggettivi: infatti, i dispositivi che abitano questa dimensione sono dotati sia di circuiti elettrici, sui quali viaggia la corrente elettrica a voltaggio di 220V, necessaria ad alimentarli e a consentirne il funzionamento, sia di circuiti elettronici, sui cui viaggia il segnale elettrico a basso voltaggio, portatore di informazioni di natura sonora.

1.3.1

digitali

I termini “digitale” e “analogico” sono posti in opposizione l’uno all’altro: qual è il loro significato? Analogico significa “fondato sul principio dell’analogia”, dunque “simile”; digitale è il termine italiano derivato dall’inglese “digit”, cifra, e significa “numerico”.

Nella vita quotidiana utilizziamo comunemente sia strumenti analogici sia strumenti digitali.

Sono analogici gli strumenti che, basandosi sul principio della somiglianza, descrivono una grandezza fisica utilizzando una grandezza analoga, simile. Il termometro a mercurio, ad esempio, descrive il valore della temperatura corporea con la lunghezza del segmento di mercurio contenuto nel tubo di vetro. L’orologio a lancette descrive lo scorrere del tempo con l’angolo della lancetta rispetto alla linea verticale. Anche il tachimetro a lancette sul quadrante dell’autovettura è uno strumento analogico: come nell’orologio a lancette, il valore della velocità istantanea è rappresentato dal valore dell’angolo della lancetta.

In tutti questi strumenti, all’aumentare della grandezza fisica osservata (temperatura, tempo, velocità) aumenta anche il valore della grandezza “altra” (lunghezza, angolo), con continuità e proporzionalità: l’andamento della prima si riflette nell’andamento della seconda.

Sono digitali gli strumenti che descrivono una grandezza fisica convertendone l’informazione un serie di numeri. Qui non si lavora per analogia: l’andamento continuo della grandezza fisica da rappresentare viene non “imitato” bensì fotografato, ad intervalli regolari di tempo, annotandone il valore numerico ogni volta. Si ottiene così una lista di numeri che, posti in sequenza, restituiscono, per approssimazione, l’andamento della grandezza.

Mentre la rappresentazione analogica è di tipo continuo, quella digitale è di tipo discreto. Ad esempio, è digitale l’orologio da polso che, sul display, visualizza lo scorrere del tempo attraverso una rappresentazione numerica, i cui valori sono aggiornati di tanto in tanto (tipicamente, ogni secondo).

L’evidente limite della rappresentazione digitale sta nella perdita di informazioni: procedendo per prelievi di valori ad intervalli temporali costanti, inevitabilmente trascureremo tutti i valori intermedi, compresi tra un prelievo e l’altro. D’altra parte, trasformare l’informazione in stringhe di numeri ci consente di affidarne l’elaborazione (la gestione, la trasformazione, la fissazione e la trasmissione) al calcolatore elettronico, con gli evidenti vantaggi noti a tutti.

Anche il segnale acustico può essere rappresentato con modalità analogiche oppure digitali.

Nella catena elettroacustica, abbiamo studiato il microfono, il dispositivo responsabile della trasduzione del suono, cioè del passaggio da segnale acustico a segnale elettrico. Esso porta a termine il proprio compito grazie ad una membrana molto sottile, che sa cogliere le variazioni di pressione dell’aria (segnale acustico) e inviarle ad un circuito elettrico, in grado di generare corrente elettrica, proporzionale all’entità delle variazioni di pressione (segnale elettrico). Al variare dei valori di pressione corrisponde, con continuità e proporzionalità, il variare dei valori del voltaggio; dunque, il segnale elettrico è una rappresentazione analogica del segnale acustico ed i dispositivi che lo gestiscono sono perciò chiamati strumenti analogici.

In conclusione, elettrificare il suono ha permesso di ottenere una rappresentazione analogica. Ma come fare per passare da una rappresentazione analogica ad una rappresentazione numerica, la sola comprensibile dal calcolatore elettronico? In altre parole, come fare per digitalizzare il suono?

Ritorniamo per un attimo nel mondo fantastico che abbiamo lasciato qualche paragrafo fa, abitato da visitatori curiosi di entrare nella cittadella fortificata, come rappresentato in figura 18 Al centro della cittadella stessa vi è un’area recintata con una cinta muraria interna, una sorta di città nella città, nella quale vivono le regole del dominio digitale.

Come nel dominio elettronico, anche nel dominio digitale vi sono due varchi, uno per entrare e uno per uscire, presidiati da due guardie, impegnate ad assicurarsi che i visitatori vestano i panni idonei per potersi muovere adeguatamente nella cittadella del digitale. All’ingresso vi è il dispositivo chiamato “ADC” (acronimo di “Analog to Digital Converter ”), preposto alla conversione (c) da segnale analogico a segnale digitale. Per svolgere l’operazione, il dispositivo “guarda in faccia” il segnale elettrico

Ora che il suono è stato imprigionato in circuiti elettrici, fermiamoci ad osservarlo: fotografiamolo e visualizziamolo, utilizzando le rappresentazioni grafiche comunemente usate dai software audio.

Percuotiamo l’estremità del diapason e ascoltiamone il suono.

Diapason

Proviamo a descriverlo con le categorie di analisi dell’acustica, già illustrate nel capitolo 1.1. La durata è piuttosto ampia, pari a circa 22 secondi; l’intensità può essere descritta con il termine “piano”, osservando che essa si riduce nel tempo allo spegnersi della vibrazione; l’altezza è determinata e, per i musicisti esperti, corrisponde alla nota La (vedremo tra poco in dettaglio a quale nota La precisamente corrisponde); infine, per descrivere il timbro, il carattere più complesso e nello stesso tempo identitario del suono, non disponendo di precisi termini tecnici, tenteremo di avvalerci di termini che fanno riferimento ad aree semantiche riferite ai sensi extra uditivi, quali la vista (luminoso/scuro, brillante/cupo), il tatto (ruvido/liscio, pesante/leggero, caldo/freddo), oppure ad aspetti materici del corpo vibrante (metallico/vitreo). Quali di questi termini potrebbero aiutarci a descrivere il timbro del suono del diapason? Scattiamo una fotografia al suono del diapason. Finalmente possiamo “guardarlo in faccia”.

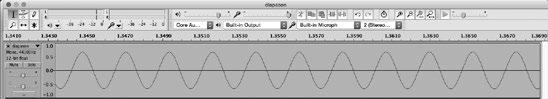

Diapason, forma d’onda (parte iniziale). Software “Audacity”

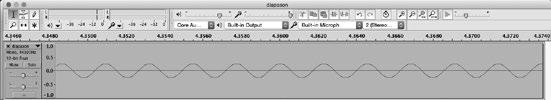

Ecco l’immagine del suono del diapason. Ora possiamo dire che i termini fino a qui utilizzati, quali, ad esempio, “oscillazione”, “vibrazione”, “onda”, sono appropriati: osserviamo infatti una linea continua modellata secondo l’andamento di un’onda. Questo tipo di rappresentazione grafica è chiamata “forma d’onda”, poiché rende visibile la forma dell’onda sonora, il cui andamento è differente per ogni suono. Ad esempio, il suono del diapason si manifesta con una forma d’onda che, ai nostri occhi, appare decisamente regolare e continua. Ben diversa sarà la forma dell’onda prodotta da strumenti musicali quali l’oboe, il clarinetto o il flauto, che tra poco andremo ad esaminare.

La forma d’onda è un grafico fondato su due assi. L’asse orizzontale, sul quale viene rappresentato lo scorrere del tempo, utilizzando una sorta di righello che riporta valori relativi non allo spazio, come nel comune righello (centimetri) ma al tempo (secondi); l’asse verticale, su cui si osserva l’ampiezza dell’onda, misurando la distanza tra l’asse orizzontale e la cresta dell’onda. Vengono distinti i valori positivi (parte superiore rispetto all’asse orizzontale) corrispondenti a quelli che in acustica avevamo chiamato fasi di condensazione (o fronti di alta pressione) e i valori negativi (parte inferiore), corrispondenti alle fasi di rarefazione (o fronti di bassa pressione). Quali sono le informazioni sul suono offerte da questa rappresentazione grafica?

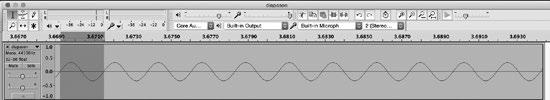

Diapason, forma d’onda (parte finale). Software “Audacity”

La prima informazione è relativa all’intensità del suono. Scattiamo ancora una fotografia al suono del diapason, non nei primi istanti, quando esso conserva la sua energia, ma negli ultimi, quando la vibrazione sta per estinguersi, ed osserviamo la differenza tra le due immagini. Con evidenza, si osserva che è maggiore l’ampiezza dell’onda nella prima immagine ed è minore nella seconda. Possiamo dunque cogliere la correlazione, già anticipata nel paragrafo 1.1 relativo all’acustica tra l’ampiezza dell’onda e l’energia fisica con la quale il corpo sonoro viene percosso e, dunque, con l’intensità del suono: ad un suono forte corrisponderà una maggiore ampiezza, mentre ad un suono piano corrisponderà una minore ampiezza. È possibile misurare l’ampiezza dell’onda sonora?

Non è semplice dare una risposta alla domanda perché le scale e le unità di misura sono molteplici e cambiano a seconda delle necessità. Per ora ci basti osservare che nella rappresentazione della forma d’onda la sinusoide si snoda tra fasi positive (area superiore del grafico) e fasi negative (area inferiore): la cresta, cioè il punto con massimo valore positivo, assume valori che vanno da 0 a 1, mentre il ventre, cioè il punto con massimo valore negativo, assume valori da 0 a -1, come riportato sull’asse verticale.

La seconda informazione è relativa all’altezza del suono. Osserviamo la singola oscillazione nel suono del diapason. Seguiamo l’andamento dell’onda, dal momento in cui lascia l’asse orizzontale, sale nella regione dei valori positivi (fase di condensazione), raggiunge l’apice (cresta dell’onda), poi scende, attraversa l’asse, affonda nella regione dei valori negativi (fase di rarefazione), raggiunge l’apice opposto (ventre) e ritorna all’asse. Di qui, l’onda ricomincerà una nuova oscillazione.

I due sonogrammi sono molti simili: entrambi rivelano la posizione della componente fondamentale alla frequenza di 440 Hz, come già osservato al momento dell’analisi delle forme d’onda. C’è tuttavia una differenza nella luminosità delle linee: a destra, risultano molto luminose la linea della fondamentale e quella della seconda armonica, mentre sono mediamente luminose o poco luminose tutte le altre, a sinistra, invece, risultano molto luminose non solo le linee della fondamentale, ma anche quelle del primo, secondo e terzo armonico e, soprattutto, quella del settimo armonico. In altre parole, nell’oboe c’è molta energia anche nelle componenti secondarie, in particolare dalla seconda alla quarta e poi sulla settima. Proprio queste differenti distribuzioni di energia nelle componenti parziali determina buona parte della qualità del timbro. Questo aspetto risulta esser particolarmente interessante se pensiamo che in futuro, in fase di elaborazione, potremo modificare questa distribuzione di energia, andando così ad alterare il timbro del suono.

Nella maggior parte dei nostri tutorial utilizzeremo il software Audacity, disponibile al sito https://www.audacityteam.org/.

Audacity è un software per l’editing e il montaggio audio digitale, multitraccia e multipiattaforma, cioè compatibile con sistema operativo Windows, Mac e Linux, open source e gratuito.

In questo primo tutorial impariamo a scaricare il software da internet e a installarlo sul nostro computer.

In questo tutorial impariamo a creare un progetto e a salvarlo sull’hard disk del nostro computer. Cliccando sull’icona, il programma si apre e presenta subito la finestra di progetto.

La finestra per il momento è vuota, ma presto sarà occupata dal suono, o meglio dalle rappresentazioni grafiche del suono. Tutto intorno, disposti sulla cornice, ci sono gli strumenti di controllo con i quali sarà possibile gestire e manipolare l’audio. Non ci lasciamo intimorire dal gran numero di pulsanti, indicatori e barre di regolazione, e ci tuffiamo subito, a capofitto, nella prima operazione: registriamo il nostro primo suono.

In questo tutorial impariamo ad esportare il materiale audio. Riapriamo il progetto ed esportiamo: in questo modo tutto il materiale sonoro delle tracce diventa un unico file audio che potrà essere letto da qualunque altra applicazione audio, come ad esempio iTunes e Spotify.

Nell’esportare, abbiamo la possibilità di scegliere tra alcuni dei formati audio più diffusi, come ad esempio il formato non compresso .wav, adatto ai casi in cui si lavora in locale, cioè salvando il materiale audio sul proprio computer, e il formato compresso AAC mp4, da preferire quando si vuole condividere l’audio in rete.

In questo tutorial impariamo a conoscere le principali funzionalità della finestra di progetto.

Riapriamo il progetto ed osserviamo la finestra. Scopriamo la barra del titolo, la barra dei menu , che raccoglie la maggior parte dei comandi di Audacity, la barra di trasporto, che permette di controllare la riproduzione del suono, la timeline e la traccia audio. Se facciamo zoom sulla traccia, vedremo da vicino la forma d’onda del suono; avvicinandoci ancora, scopriamo che essa è composta da piccoli puntini: sono i campioni, l’unità base dell’audio digitale.

In questo tutorial impariamo a importare file audio nel progetto. Nel progetto di Audacity, se accanto alla nostra registrazione vogliamo aggiungere del materiale già esistente, come ad esempio un file audio presente in una cartella del nostro computer, dobbiamo agire con la funzione Importa presente nel menu File .

I progetti qui presentati fanno riferimento a particolari ruoli professionali e si fondano su situazioni concrete della vita contemporanea. Non sono perciò presentati astrattamente, ma possono essere utilizzati come veri e propri compiti di realtà .

Il progetto Sonorama ci permetterà di passare dalla dimensione acustica, già esplorata negli studi precedenti, a quella elettronica, offerta dal computer. Ci organizzeremo in forma di orchestra Sonorama e assumeremo tutti il ruolo di rumorista cinematografico o, con il termine inglese, Foley artist. Il nostro compito sarà quello di creare i suoni che accompagnano i gesti e i movimenti dei protagonisti di una video animazione: i piccoli insetti che abitano un ecosistema (l’episodio “Sans coquille” tratto dalla serie di produzione francese “Minuscule”). Ogni studente analizzerà la traccia video, osserverà le caratteristiche fisiche del personaggio a lui assegnato, i suoi gesti e movimenti, e immaginerà il suono capace di esprimerli compiutamente; cercherà il corpo sonoro e, come il rumorista cinematografico, lo suonerà dal vivo, mentre scorrono le immagini. L’intera orchestra sarà impegnata nella sonorizzazione dal vivo, con corpi sonori, della video animazione. Terminata la fase di produzione acustica, inizieremo la fase elettronica: registreremo tutti i suoni, li editeremo e li organizzeremo in una libreria sonora. A quel punto, ogni studente cambierà ruolo: non sarà più impegnato a sonorizzare il personaggio assegnato; ma potrà, in autonomia, oppure in coppia con un compagno, realizzare il montaggio audio di tutti i suoni per la video animazione; facendosi autore dell’intera colonna sonora, egli imparerà a controllare l’insieme e non solo il dettaglio.

• Ruolo: rumorista cinematografico o Foley Artist con l’utilizzo di strumenti sia acustici che digitali.

• Attività: produzione dei suoni che accompagnano i movimenti dei personaggi di una video animazione.

• Supporto extra-musicale: video animazione “San coquille”, episodio della serie Minuscule

• Fasi: analisi della video animazione, produzione acustica con corpi sonori, esecuzione in sincrono con la video animazione (orchestra Sonorama), registrazione, editing di base, montaggio audio su video animazione.

• Strumenti: corpi sonori, software per l’editing, il trattamento e il montaggio audio (Audacity), software per la lettura di file video (Windows Media Player oppure Quick Tim).

OggettO

Foley Art indica la pratica di riproduzione in studio dei suoni prodotti dai gesti e dai movimenti dei protagonisti di una scena di un film. L’espressione deriva dal nome di Jack Foley, sound editor impegnato negli studi della Universal, che nel 1929, in occasione della produzione per il Musical “Show Boat”, diede inizio alla pratica, aggiungendo alla pellicola muta alcuni suoni sincronizzati ai movimenti degli attori, mirando ad aumentare l’impatto del film sul pubblico.

La procedura prevede la perfetta sincronia tra suono e immagine: il Foley artist studia il movimento del personaggio, immagina il suono che andrà a sottolinearlo, reperisce i corpi sonori idonei allo scopo, esplora la tecnica esecutiva ed infine, muovendosi egli stesso come un attore, esegue i suoni mentre scorrono le immagini sullo schermo.

L’obiettivo della Foley art è attribuire realismo alla scena o addirittura esagerarlo, nell’intento di intensificare l’esperienza dello spettatore. La ragione per cui i suoni Foley, prodotti in studio, sono preferibili ai suoni reali è legata alla resa: ad esempio, il suono dello schiaffo, prodotto colpendo con un palmo della mano una bistecca cruda, ne restituisce l’impatto fisico e il valore emotivo con efficacia maggiore rispetto al corrispondente suono reale.

Dopo l’avvio da parte di Jack Foley, la pratica conobbe un enorme sviluppo nel settore del film di animazione, che imponeva un ingente sforzo di sonorizzazione in studio (post produzione), giacché era completamente assente la tradizionale fase di ripresa dal vivo di immagini e suoni, con attori reali e set fisico (produzione). Jimmy Mac Donald, attivo agli studi Disney fin dagli anni 30, fu tra i maggiori esperti del settore: si distinse per la capacità di inventare non soltanto i suoni nuovi, adatti ai personaggi animati, ma anche i dispositivi fisici con cui produrli.

attualità

Oggi la Foley art è una fase del ciclo di produzione sonora per il film, insieme agli effetti sonori, vale a dire l’apparato progettato e sviluppato appositamente per conferire alla scena caratteri di realismo e di verosimiglianza, costituito da suoni di natura ambientale (vento, mare, ambienti urbani), meccanica (accensione di motori, corse di automobili) e legati dai gesti dell’uomo: i suoni Foley, appunto. Mentre i primi possono essere facilmente registrati e applicati in tempi successivi, o perfino scelti all’interno di librerie sonore disponibili sul mercato, con notevoli vantaggi sui tempi e sui costi di produzione, i suoni legati al movimento umano, complesso e articolato, non possono che essere originali, prodotti ed eseguiti dal vivo, simultaneamente allo scorrere delle immagini. legame cOn l’apprendimentO muSicale La condizione che assicura l’efficacia della Foley Art è la presentazione simultanea e sincronica di un gesto e di un suono privato della fonte che lo ha prodotto. L’assenza del referente porta l’ascoltatore a concentrarsi sugli attributi sonori (ascolto acusmatico) ed a traslarli sull’immagine: in questo modo il gesto rappresentato visualmente verrà riconosciuto come la fonte del suono e ne acquisirà le qualità.

Per questo motivo, praticare la Foley Art significa imparare a riflettere sulle qualità morfologiche del suono. Il ragazzino Foley Artist studia il gesto, ne coglie le caratteristiche specifiche e progetta il suono adatto ad esprimerle; a questo punto passa alla fase di invenzione sonora: esplora i corpi acustici, ne indaga le sonorità nascoste, sperimenta tecniche esecutive inedite, arriva a costruire nuovi dispositivi ed infine esegue il tutto dal vivo. Successivamente, con il supporto dell’elettronica, egli regista i materiali sonori, li edita e li organizza in una libreria sonora originale, quindi realizza un montaggio audiovideo che testimonia l’esperienza.